Introducción al modelo transformer y sus aplicaciones

Introducción al modelo transformer y sus aplicaciones

¡Hola! Si estás interesado en el mundo fascinante de la inteligencia artificial, el modelo transformer es uno de esos avances que ha revolucionado cómo las máquinas procesan y generan lenguaje. Desarrollado por Google en 2017, este algoritmo de IA se basa en una arquitectura innovadora que utiliza atención para capturar relaciones complejas en los datos, superando a los modelos tradicionales como las redes neuronales recurrentes. Con aplicaciones en traducción automática, generación de texto y más, los transformers han impulsado el progreso en algoritmos de IA, permitiendo avances en procesamiento de lenguaje natural y análisis de datos. Imagina chatear con un asistente virtual que entiende el contexto completo de tu conversación; eso es gracias a la eficiencia y escalabilidad de este modelo. En este artículo, exploraremos sus bases, usos y futuro, de manera amigable y accesible para todos los entusiastas de la IA.

Fundamentos del modelo transformer

Para entender el modelo transformer, es esencial conocer sus bases teóricas y estructurales, que lo distinguen en el panorama de los algoritmos de IA. Este enfoque se centra en la "atención" como mecanismo clave, lo que permite procesar secuencias de datos de manera paralela y eficiente, mejorando el rendimiento en tareas de inteligencia artificial.

Componentes clave del transformer

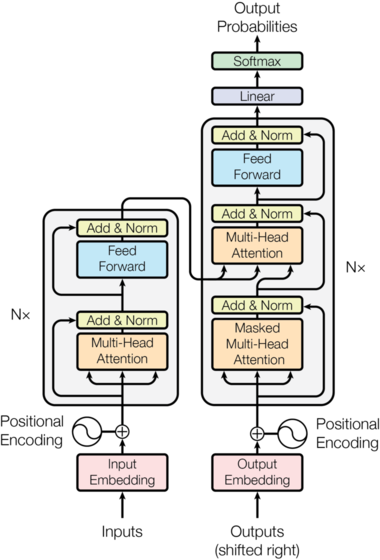

El transformer se compone de varios elementos esenciales, como los codificadores y decodificadores, que trabajan en conjunto para manejar datos secuenciales. Estos componentes utilizan capas de atención múltiple para ponderar la importancia de diferentes partes del input, lo que es vital en algoritmos de IA para tareas como la traducción, donde el contexto global es crucial.

Cómo funciona el mecanismo de atención

El mecanismo de atención en el transformer permite que el modelo enfoque en partes relevantes de la secuencia de entrada, calculando pesos para cada elemento. Esto hace que los algoritmos de IA basados en transformers sean más rápidos y precisos, ya que evitan el procesamiento secuencial de datos, optimizando el entrenamiento y la inferencia en aplicaciones de inteligencia artificial.

Qué es el aprendizaje supervisado y no supervisadoAplicaciones en inteligencia artificial

Las aplicaciones del modelo transformer se extienden a diversos campos dentro de los algoritmos de IA, demostrando su versatilidad y capacidad para resolver problemas complejos en el procesamiento de datos. Desde el lenguaje hasta la visión por computadora, este modelo ha abierto puertas a innovaciones prácticas y cotidianas.

Procesamiento de lenguaje natural

En el procesamiento de lenguaje natural, los transformers son fundamentales para tareas como la generación de texto y el análisis sentimental. Modelos como BERT y GPT, derivados de esta arquitectura, utilizan algoritmos de IA para entender y generar lenguaje humano, mejorando chatbots y motores de búsqueda con resultados más intuitivos y contextualmente precisos.

Extensión a otras áreas de IA

Más allá del lenguaje, los transformers se adaptan a áreas como la visión por computadora, donde ayudan en el reconocimiento de imágenes y la generación de contenido visual. Estos algoritmos de IA permiten procesar datos multimedia de manera eficiente, fomentando avances en campos como la medicina y el automóvil autónomo, donde la precisión es clave.

Ventajas y desafíos de los transformers

Al evaluar el modelo transformer, es importante considerar tanto sus ventajas como los desafíos que presenta en el desarrollo de algoritmos de IA. Esta perspectiva equilibrada ayuda a los lectores a apreciar su impacto real y las áreas de mejora necesarias en la inteligencia artificial.

Cómo se entrena una red neuronal convolucionalVentajas en el rendimiento de IA

Una de las principales ventajas de los transformers es su capacidad para manejar grandes volúmenes de datos con alta eficiencia, lo que acelera el entrenamiento de modelos de IA. Esta característica hace que sean ideales para escalar aplicaciones, permitiendo avances en investigación y desarrollo donde la velocidad y la precisión son esenciales para los algoritmos de inteligencia artificial.

Desafíos y consideraciones éticas

Sin embargo, los transformers enfrentan desafíos como el alto consumo de recursos computacionales y riesgos éticos, como el sesgo en los datos de entrenamiento. En el contexto de algoritmos de IA, es crucial abordar estos problemas para garantizar que las aplicaciones sean justas y sostenibles, promoviendo un uso responsable de la tecnología en la inteligencia artificial.

En resumen, el modelo transformer ha transformado el paisaje de los algoritmos de IA, ofreciendo herramientas poderosas para innovar en múltiples sectores. Su impacto en el procesamiento de datos y la generación de inteligencia artificial es innegable, y con el continuo avance, el futuro luce prometedor. ¡No esperes más, explora transformers en tus propios proyectos de IA y descubre cómo puedes contribuir a esta emocionante revolución tecnológica!

Algoritmos de clasificación más usados en iaSi quieres conocer otros artículos parecidos a Introducción al modelo transformer y sus aplicaciones puedes visitar la categoría Modelos.

Entradas Relacionadas