Cómo funciona el attention mechanism en modelos modernos

Cómo funciona el attention mechanism en modelos modernos

En el fascinante mundo de la inteligencia artificial, el attention mechanism ha revolucionado la forma en que las máquinas procesan y comprenden datos complejos. Imagina que estás en una conversación animada: en lugar de recordar todo por igual, te enfocas en lo más relevante. Eso es exactamente lo que hace el attention mechanism en los modelos de IA modernos. Este algoritmo permite a las redes neuronales priorizar información clave, mejorando el rendimiento en tareas como el procesamiento de lenguaje natural y la visión por computadora. Con su adopción en modelos como los transformers, el attention mechanism ha impulsado avances significativos en algoritmos de IA, haciendo que las aplicaciones sean más eficientes y precisas. Si eres un entusiasta de la IA, entender este concepto te abrirá puertas a innovaciones emocionantes.

Conceptos básicos del Attention Mechanism

Para adentrarnos en el attention mechanism, es esencial comenzar por sus fundamentos. Este componente clave en los algoritmos de IA permite a los modelos enfocarse en partes específicas de los datos de entrada, en lugar de tratarlos de manera uniforme. Esto es particularmente útil en secuencias largas, como oraciones en el procesamiento de lenguaje, donde no todos los elementos tienen la misma importancia.

Orígenes y evolución

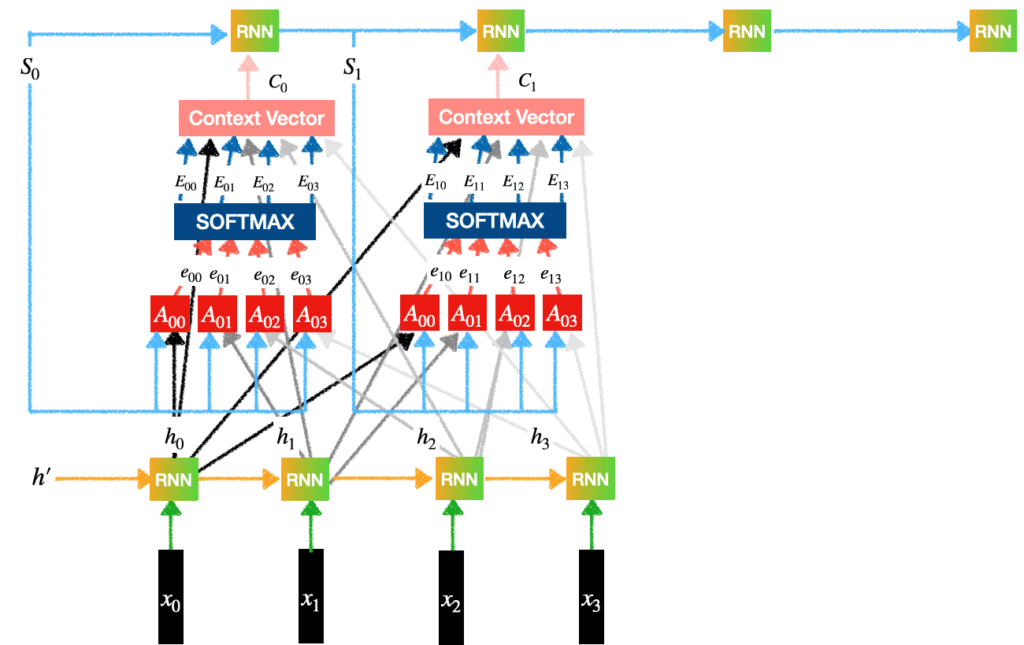

El attention mechanism surgió como una solución a los límites de los modelos de redes neuronales recurrentes tradicionales. Inicialmente propuesto en 2014, evolucionó rápidamente con contribuciones de investigadores en deep learning. Hoy, es fundamental en modelos modernos de IA, permitiendo un manejo más efectivo de datos secuenciales y mejorando la precisión en tareas de traducción automática y generación de texto.

Componentes clave

En su núcleo, el attention mechanism involucra cálculos como la puntuación de atención y los pesos suaves. Estos componentes ayudan a los algoritmos de IA a asignar importancia variable a diferentes partes de los datos. Por ejemplo, en un modelo de transformers, esto se traduce en una mayor eficiencia al procesar información relevante, reduciendo errores y optimizando el tiempo de entrenamiento.

Cómo aplicar transfer learning en proyectos pequeñosAplicaciones en modelos modernos

El attention mechanism no es solo una teoría; se aplica ampliamente en diversos modelos de IA contemporáneos. Desde el procesamiento de lenguaje hasta la visión por computadora, este algoritmo ha transformado la manera en que las máquinas interpretan patrones complejos, haciendo que los sistemas sean más intuitivos y adaptables.

En transformers

En los modelos transformers, el attention mechanism es el corazón del sistema. Permite que la red preste atención a diferentes palabras en una oración simultáneamente, superando las limitaciones de las secuencias secuenciales. Esto ha impulsado el éxito de modelos como BERT y GPT en tareas de IA, donde la comprensión contextual es clave para resultados precisos.

En otras arquitecturas

Más allá de los transformers, el attention mechanism se integra en arquitecturas como las redes convolucionales para tareas de visión. Aquí, ayuda a enfocar en regiones específicas de una imagen, mejorando la detección de objetos y el reconocimiento facial. Esta versatilidad hace que los algoritmos de IA sean más robustos y aplicables en escenarios reales.

Ventajas y desafíos

Al explorar las ventajas y desafíos del attention mechanism, vemos cómo este algoritmo de IA equilibra beneficios con complejidades. Mientras ofrece mejoras significativas en el rendimiento, también plantea retos que los desarrolladores deben abordar para optimizar su uso.

Qué es el preprocesamiento de datos para modelos de iaBeneficios

Una de las principales ventajas es la capacidad para manejar datos de larga distancia, lo que mejora la eficiencia en modelos de IA. Por ejemplo, en el análisis de texto, permite capturar relaciones entre palabras distantes, resultando en interpretaciones más precisas y reduciendo el overfitting en algoritmos de deep learning.

Desafíos y soluciones

Sin embargo, el attention mechanism puede aumentar la complejidad computacional, lo que representa un desafío en entornos con recursos limitados. Soluciones como el uso de attention multi-cabeza o mecanismos de compresión ayudan a mitigar esto, asegurando que los modelos de IA permanezcan escalables y eficientes en aplicaciones prácticas.

En resumen, el attention mechanism es un pilar fundamental en los modelos y algoritmos de IA modernos, permitiendo avances que hacen que la tecnología sea más inteligente y accesible. Si estás explorando este campo, considera experimentar con estos conceptos en tus propios proyectos para descubrir su potencial. ¡Optimiza tus modelos de IA hoy con attention mechanism!

Cómo elegir el mejor algoritmo para tu modelo de iaSi quieres conocer otros artículos parecidos a Cómo funciona el attention mechanism en modelos modernos puedes visitar la categoría Modelos.

Entradas Relacionadas